近日,AI 创业公司**「DreamTech」**连续完成数千万元天使轮及天使+轮融资,天使轮为元禾原点领投,启迪之星创投、云天使基金跟投,天使+轮为初心资本独家投资。

初心资本合伙人许旸洋表示:“我们坚信技术创新是 3D 生成技术迅猛发展浪潮中构建核心竞争力的基石。正如 Midjourney 凭借其自主研发的模型赢得市场认可,Runway 作为 Stable Diffusion 的共同创造者获得业界赞誉。

初心看好在 3D 生成领域深耕细作,具备技术壁垒与优秀迭代能力的团队。DreamTech 的原生三维生成技术突破了传统 3D 生成的限制,其生成速度和质量均达到了商业化要求,解决了长期困扰行业的高质量三维内容生成难题。

DreamTech作为稀缺的具有深厚学术积累和明确应用场景的 3D 生成平台及应用开发商,初心看好其团队持续打造质量过硬、市场信任的模型及产品的能力,并致力于与团队并肩前行,从 3D 原生出发,迎接 4D 时空体验的到来。”

以下内容摘自 36氪。

就像语言大模型技术的进步直接推动了 ChatGPT 等文本生成 AI 的浪潮一样,在图像、视频、三维领域,大模型技术也推动了包括 2D、3D 等生成式 AI �的进步。

「DreamTech」就是一家专注于原生 3D 生成的 AI 创业公司,公司于 2023 年 12 月开始正式运营。CEO 张飞虎博士毕业于牛津大学,团队的创始成员包括了英国两院院士,国家级青年人才,腾讯会议创始成员等,曾在苹果、腾讯、百度等行业领先企业任职。创始团队成员曾成功创立多家成为 3D 领域标杆的公司,这些公司分别被苹果、谷歌、博世等业界巨头收购。

除了文本内容之外,生成式 AI 首先作用于 2D 图像的生成,从 2022 年开始,包括 Midjourney、Stability AI 等专注 AI 生成图片方向的公司迅速崛起,带动了文生图领域的迅速繁荣,而 OpenAI SORA,Luma Dream Machine,快手可灵等 AI 生成视频方向的应用也成为当前热点,如今,文生图、文生视频领域已经有不少基座模型,技术路线也趋于收敛。而相较于 2D 图像及视频,3D 内容生成这一细分领域所处的发展阶段更早,技术路线在之前一直处于探索期。

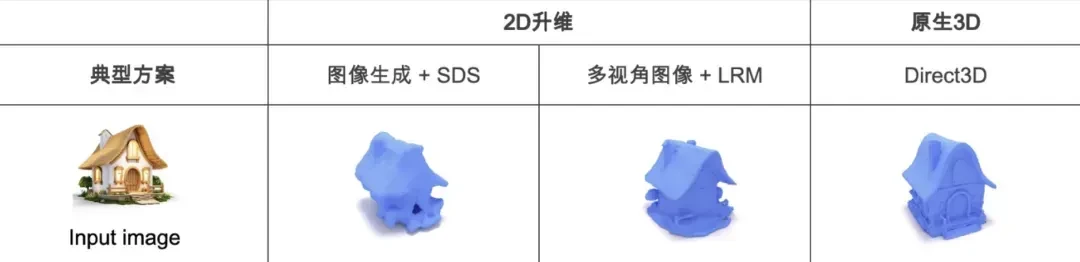

如果想利用 AI 生成一个 3D 的立体模型,主要有 2D 升维和原生 3D 种技术路线。此前,绝大多数公司采用 2D 升维路线——具体来说,2D 升维需要先经历从文字或单张 2D 图像到多视角图像,再进行重建得到 3D 模型,其优势是可在现有图像生成模型(例如 Stable Diffusion)基础上进行微调,更容易完成训练。缺点是过程复杂,中间的误差累计导致生成的 3D 模型出现畸形、多头等质量问题。

另外,由于 2D 图像本质上缺少 3D 信息,而 2D 升维的模型架构设计上主要针对 2D 数据处理进行优化,无法继续像大语言模型一样 scale up,生成质量已经达到瓶颈,即使增加模型参数和训练数据,3D 生成质量也很难继续提高。

相较之下,原生 3D 采用纯 3D 数据进行训练,优点是由于训练的数据和优化的目标都是原始的 3D ��模型,生成的 3D 模型质量和效果会更好,更接近原始 3D 模型的质量,也更能处理应对复杂场景。

“但最大的难点在于,全世界的 3D 数据稀缺且昂贵,据估计,全世界的高质量 3D 数据仅有 400-500 万左右,而且建模依赖于人工,制作成本高且花费时间长,通常一个高质量的 3D 模型在建模环节就需要花费专业三维设计师约 2 周时间。并且,相比较于图像、视频这类 2D/2.5D 规则数据易于 latent 表征,3D Diffusion 的训练中数据维度更高过程需要耗费巨量的算力。”张飞虎表示。

DreamTech 团队之所以选择原生 3D 路线,首先是其在高效的 3D 模型表征上找到了新的方法,通过 Decoder 网络实现了对原始 3D 数据近乎无损的恢复。

其次,团队基于 Diffusion Transformer 架构,在 3D 领域做了大量优化,在扩大训练数据规模以及增加参数量后,大模型的生成质量会得到巨大提升。

一个典型例子是, OpenAI 在 2024 年发布的 SORA,就是基于 Diffusion Transformer 架构进行训练,展示了震惊世界的生成效果,无论是视频分辨率、视频时长还是视频生成质量都得到了极大提升。

再者,为了解决 3D 数据困境,DreamTech 团队自研了一套 3D 数据合成引擎,建立了数据清洗、标注等全自动数据处理流程,其产出的 3D 数据在千万量级,均为高质量数据,能够用于进一步的模型训练。

在今年5月,DreamTech发布了采用3D Diffusion Transformer(3D-DiT)架构的Direct3D-1B模型(10亿参数)。张飞虎表示,这是全球首个公开发布的原生三维生成路线的3D大模型。随着训练数据量的增加,模型的生成质量明显提升,接下来,团队还会进一步扩大模型参数和训练规模。

并且,尽管用的是原生3D路线,训练成本反倒减少了。基于原生3D数据模型表征及3D-DiT训练上的突破,DreamTech把训练和推理的算力成本压缩为了原先的十分之一,将原本需要千卡以上的训练任务压缩到了百卡规模。

张飞虎表示,预计今年年底,在产品工程层面,团队还会进一步优化,将图像或文字生成3D内容的模型推理时间压缩至30秒以内。

当前,DreamTech在模型层面已经完成初步开发,接下来将逐步迭代,产品层面也在同步准备,下半年将启动产品落地。团队计划先从游戏、二次元人群的C端产品入手,推出符合二次元用户娱乐社交需求的相关产品。在B端用户上,也会针对游戏、动画创作者推出基于原生3D大模型生成能力的三维创作平台。

关于长远目标,DreamTech团队成员认为,从语言、图片到视频以及接下来的真实世界模拟器,多模态路线演进过程中必然绕不开三维空间。“真实的世界是四维世界,是有空间、时间维度的。”张飞虎表示,“我们的目标是做有时空交互的真实世界的模拟器,从3D路线出发,对应了三维空间,之后加入实时交互与物理引擎,就能模拟还原真实世界。而真实世界模拟器是训练通用人工智能的必要工具,通过大量模拟不同参数下的真实世界,通用人工智能才能更快实现。”

据悉,DreamTech新一轮融资也即将启动,一苇资本担任独家财务顾问。